Més de 200 veus de pes, entre elles premis Nobel, investigadors i ex caps d’Estat, han signat una crida internacional per fixar línies vermelles globals sobre la intel·ligència artificial (IA) abans de finals de 2026. L’advertència no es queda en una nota tècnica: demana acordar quins usos han de quedar prohibits d’arrel, des de la suplantació de persones fins a l’autoreplicació autònoma. La proposta es planteja com un antídot davant el risc que els Estats arribin tard a regular una tecnologia que ja opera a velocitat de vertigen.

Un manifest amb urgència incorporat

El text, titulat Global Call for AI Red Lines, sorgeix de la coalició Red Lines & AI Safety i reclama un acord polític internacional que marqui límits clars als sistemes d’IA. Va ser presentat durant la 80a sessió de l’Assemblea General de Nacions Unides, cosa que atorga al manifest una projecció diplomàtica immediata. La idea és fixar des d’ara quins usos mai no s’haurien de permetre, sense importar el país, l’empresa o el context. I el calendari també és precís: els promotors volen que el consens estigui signat abans que acabi el 2026.

Quins usos quedarien prohibits

El document identifica cinc comportaments extrems de la IA que haurien de quedar fora de la llei: la suplantació d’identitat humana, les falsificacions profundes a gran escala, l’autoreplicació de sistemes sense control humà, el desplegament de models autònoms en infraestructures crítiques i la intervenció armamentística sense supervisió humana. A més, es planteja la creació d’una instància internacional de supervisió, capaç de vigilar el compliment i de respondre en cas d’incompliment. L’esperit de la proposta es resumeix en una idea: prevenir abans de lamentar.

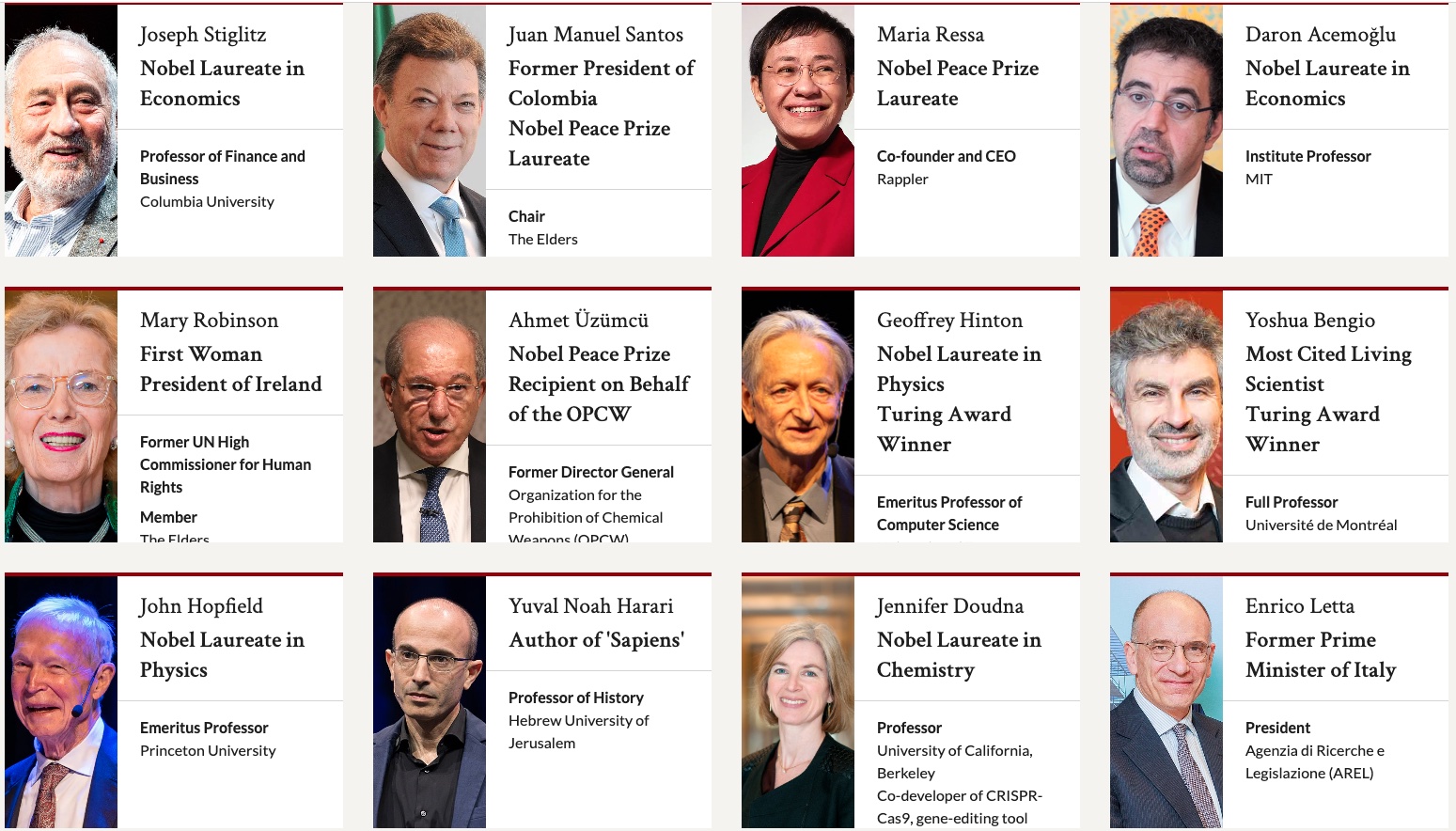

Qui fa costat a la crida

El document reuneix més de 200 signatures de referència, des de científics guardonats amb el Nobel, a pioners de la IA, ex presidents i primeres ministres, a més de representants de més de 70 organitzacions acadèmiques i de recerca. El ventall de suports és inèdit en aquest camp, ja que s’expandeix més enllà de la comunitat científica d’ IA i inclou figures de l’economia, els drets humans i la diplomàcia. L’amplitud de suports busca donar solidesa moral i política al missatge. El risc que tots subratllen és que la IA, en la seva cursa cap a la sofisticació, sigui utilitzada com a eina de manipulació massiva o adquireixi dinàmiques incontrolables.

Riscos sense tallafocs

El Global Call for AI Red Lines adverteix que, sense normes internacionals vinculants, la humanitat enfrontarà riscos creixents: des de pandèmies dissenyades o campanyes de desinformació massiva, fins a amenaces a la seguretat global, abusos sistemàtics de drets humans i la pèrdua de control humà sobre sistemes avançats. Per als seus impulsors, la lliçó està en els precedents: acords internacionals que van prohibir l’ús d’armes biològiques o la clonació humana. La proposta pretén replicar aquesta lògica de prohibicions universals i fer-la efectiva amb mecanismes de compliment.

Les escletxes d’un consens global

El plantejament, però, obre diverses preguntes. Com definir límits comuns entre països amb marcs legals i prioritats tan diferents? El que un Estat considera amenaça existencial, un altre pot veure-ho com a oportunitat econòmica. Tampoc és clar qui sancionaria, com es vigilaria i quin paper tindrien les grans tecnològiques, que avui concentren la capacitat més gran de desenvolupament. I sempre apareix el dilema clàssic: quant risc s’està disposat a acceptar per no frenar la innovació.

Entre Brussel·les, Nova York i Silicon Valley

La iniciativa se suma a un tauler on ja es mouen peces. La Unió Europea ha aprovat la seva Llei d’ IA, amb categories de risc i exigències de transparència, encara que no arriba a traçar prohibicions universals. Nacions Unides ha iniciat debats sobre governança tecnològica, però sense terminis vinculants. En paral·lel, centres com el Center for AI Safety als Estats Units o CeSIA a França fa temps que demanen barreres ètiques globals. La diferència ara és la urgència i el marc temporal concret de 2026 com a horitzó inajornable.

Un rellotge en compte enrere

La reclamació dels Nobels deixa una imatge clara: un rellotge que avança cap al 2026 mentre els Estats encara discuteixen qui ha de liderar la conversa. El dilema és doble. Si no es pacten línies vermelles, la IA podria avançar sense tallafocs. Si es pacten tard, potser els sistemes més potents ja estiguin en circulació. El temps, més que la tecnologia, sembla ser la veritable mesura del risc.

Obre un parèntesi en les teves rutines. Subscriu-te al nostre butlletí i posa’t al dia en tecnologia, IA i mitjans de comunicació.