Fins ara, per reportar un cotxe aturat o un embús a Waze exigia deixar el volant, detenir la mirada, buscar la icona correcta i confirmar. Ara, l’app vol que el conductor simplement ho digui en veu alta. “Hi ha alguna cosa a la carretera”, “Trànsit intens”, “Vehicle aturat”. Sona quotidià, però darrere s’amaga una peça més del gran experiment de Google per fer que la tecnologia entengui com parlem —i no al revés—.

La veu com a nou gest

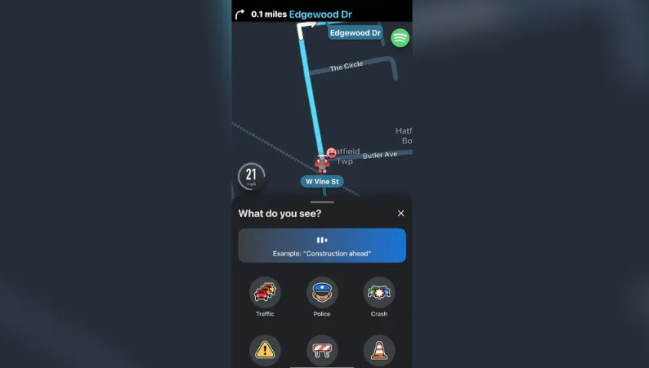

La funció Conversational Reporting, arriba un any després de ser anunciada (fins ara només estava en fase beta), s’activa amb un toc i una frase. Res de menús ni botons petits. Si el missatge és clar, el sistema el tradueix a l’instant en una alerta visible per a altres conductors; si dubta, respon amb naturalitat: “Pots descriure el que veus?”. El copilot invisible que suggereix Waze està impulsat per Gemini, el model de llenguatge de Google capaç de captar context i to. És, en el fons, una conversa disfressada d’informe, el conductor parla com ho faria amb un passatger i la màquina escolta, interpreta i actua.

Menys taps, més atenció

Waze ho presenta com un avanç en seguretat. Cada gest eliminat compta. Menys pantallazos, menys distracció. La funció permet reportar sense apartar la vista de la carretera, i cada avís s’incorpora de seguida al mapa, on altres poden anticipar-se a l’obstacle.

La novetat arriba, a més, en paral·lel a la retirada de Google Assistant a Waze per a iPhone, després de mesos de fallades. Gemini pren el relleu. A Android, ambdós conviuen, de moment, com dos copilots que encara es reparteixen el volant.

El que passa entre veu i núvol

Darrere d’aquest gest senzill hi ha una cadena complexa. La veu s’envia al núvol, on Gemini analitza el que s’ha dit, identifica entitats (“embús”, “vehicle aturat”, “objecte a la via”) i genera l’avís. El punt exacte de l’incident es marca quan el conductor inicia el report, no quan acaba de parlar. Una precisió mínima que evita confusions, però que revela fins a quin punt Waze es construeix en segons i coordenades. Als ajustaments, sota “Veu i so”, es pot activar o silenciar la funció. En fer-ho, apareix una petita icona animada, el senyal que l’app està, literalment, escoltant.

Entrebancs a la primera corba

Les primeres proves han portat també el seu soroll. Alguns usuaris de la comunitat beta en fòrums de Waze asseguren que l’avís d’activació reapareix encara que s’hagi configurat, que la música es talla en parlar i no sempre torna. En CarPlay, la compatibilitat és encara parcial. I, per ara, només entén anglès.

Res inusual per a una beta, però suficient perquè l’entusiasme inicial es freni una mica. Tot i això, Waze manté la seva essència: una comunitat que no només comparteix camins, sinó que comença a conversar amb ells.

L’espill de la competència

Google Maps ha introduït formes més simples de reportar incidents, encara que cap tan conversacional. Apple Maps, per la seva banda, continua sense oferir un sistema comunitari equivalent. En aquest terreny, Waze conserva la seva identitat més viva: el mapa coral que es construeix paraula a paraula, avís a avís.

Un copilot que aprèn a escoltar

El veritable salt no és tècnic, sinó cultural. Waze busca que la relació amb l’app deixi de ser una seqüència de tocs i pantalles per convertir-se en una interacció més orgànica. Però el repte està en l’invisible, en aconseguir que aquesta veu reconegui tots els accents, totes les formes de descriure un sot o un cotxe aturat.

Obre un parèntesi en les teves rutines. Subscriu-te a la nostra newsletter i posa’t al dia en tecnologia, IA i mitjans de comunicació.