La batalla per la IA militar ja ha començat: qui mana quan la guerra entra a l’algoritme. El xoc entre Anthropic i el Pentàgon revela que el gran debat ja no és què pot fer la intel·ligència artificial, sinó qui decideix fins on se li permet arribar en nom de la seguretat.

La intel·ligència artificial ha entrat en una fase diferent. Ja no se’n discuteix només l’impacte en la productivitat, en l’educació, en la creativitat o en l’ocupació. La qüestió decisiva comença a ser una altra, molt més aspra i molt més política: què passa quan els sistemes d’IA passen a formar part de la maquinària militar, de la intel·ligència d’Estat i de la lògica estratègica de les grans potències. És aquí on el conflicte entre Anthropic i el Pentàgon adquireix una dimensió que va molt més enllà d’una disputa empresarial o contractual. No som davant d’una anècdota de Silicon Valley. Som davant d’una escena fundacional del nou ordre tecnològic: el moment en què es posa a prova qui fixa els límits ètics de la IA quan els interessos de seguretat nacional xoquen amb les promeses públiques de responsabilitat.

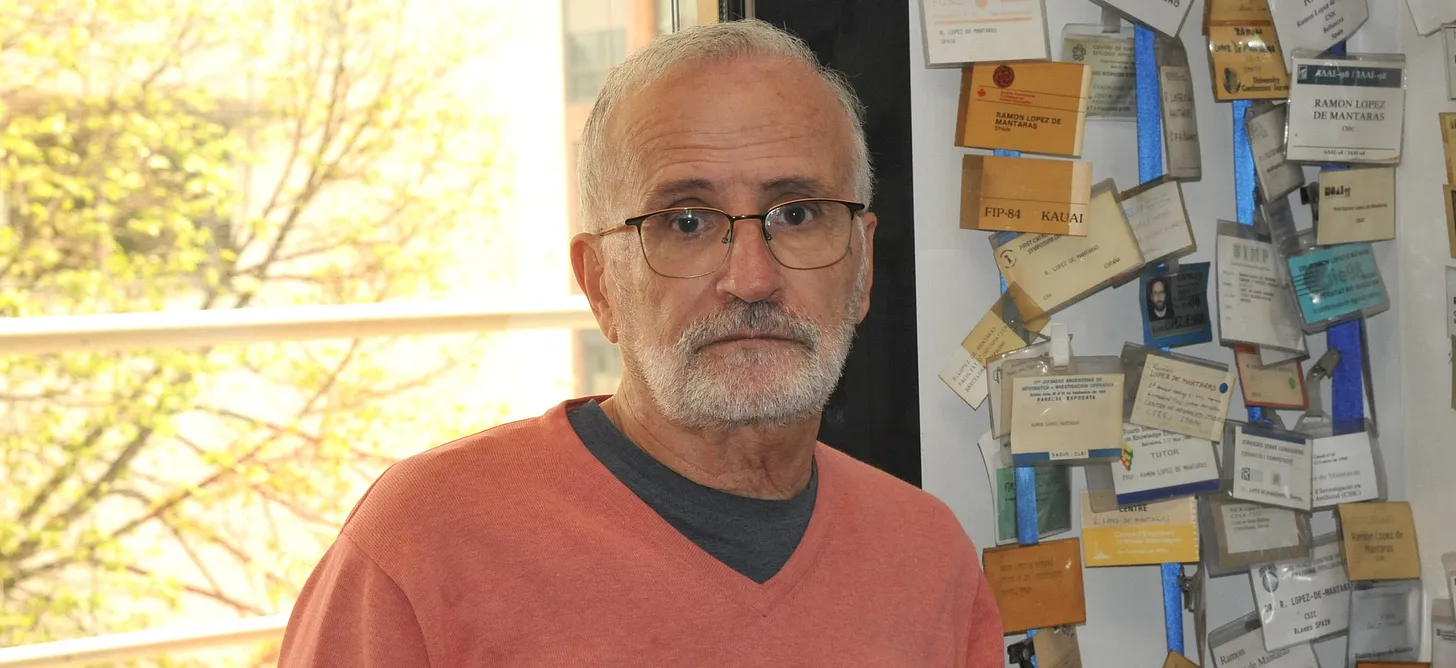

La tribuna de Ramón López de Mántaras publicada a El País situa amb claredat aquest conflicte al centre del debat contemporani. La seva tesi és rotunda: el topall entre Anthropic i el Departament de Defensa dels Estats Units no només exposa una tensió entre empresa i Estat, sinó que anticipa la gran lluita dels pròxims anys per la governança tecnològica. El focus no està únicament en Claude, en Dario Amodei o en el Pentàgon. El focus és al buit polític i normatiu que s’obre quan una tecnologia d’enorme poder operatiu avança més de pressa que els mecanismes democràtics dissenyats per controlar-la. Font principal: Ramón López de Mántaras, “IA y ética en tiempos de guerra: el conflicto que marca el futuro de la gobernanza tecnológica”, El País, 6 de març de 2026.

El més inquietant de l’episodi és que deixa al descobert una realitat que durant massa temps s’ha volgut suavitzar amb llenguatge corporatiu. Quan els governs renuncien a establir límits legals clars, obligatoris i actualitzats sobre l’ús militar de la intel·ligència artificial, no sorgeix un espai neutral. El que apareix és un terreny colonitzat per la pressió geopolítica, els contractes públics, la cursa per la supremacia tecnològica i les decisions privades d’un grapat de companyies capaces de condicionar tant el mercat com les infraestructures crítiques del poder. Aquest és l’autèntic cor del problema: la governança no desapareix, simplement canvia de mans.

Durant anys, una part rellevant de la indústria tecnològica va intentar projectar la idea que l’autoregulació podia ser suficient. Principis ètics, manifestos d’ús responsable, comitès interns, polítiques de seguretat i línies vermelles voluntàries es van presentar com a prova d’una nova maduresa del sector. El problema és que aquesta arquitectura, útil en el terreny reputacional, es torna extraordinàriament fràgil quan xoca amb la lògica de l’Estat, especialment en contextos de competència militar o estratègica. El cas Anthropic ho evidencia amb cruesa. Si una empresa insisteix a vetar certs usos de la seva tecnologia i el govern interpreta que aquests límits obstaculitzen interessos de defensa, el conflicte deixa de ser ètic per convertir-se en una pulsió de poder.

És aquí on l’article de López de Mántaras resulta especialment valuós. No es limita a descriure una fricció conjuntural, sinó que la insereix en una tendència més àmplia: la progressiva absorció de la IA per l’esfera militar i de seguretat. Aquesta tendència no afecta només Anthropic. OpenAI va anunciar el juny de 2025 “OpenAI for Government” i va detallar un contracte amb un sostre de 200 milions de dòlars amb el Departament de Defensa per desenvolupar prototips i aplicacions en àmbits administratius, sanitaris i de ciberdefensa. Meta ja havia comunicat el novembre de 2024 que posava els seus models Llama a disposició del govern dels Estats Units i de socis vinculats a la seguretat nacional. Google, per la seva banda, va modificar el febrer de 2025 la redacció dels seus principis d’IA i va eliminar referències explícites que durant anys havien servit per marcar distàncies amb certs usos militars i de vigilància. No es tracta, per tant, de casos aïllats. És una reconfiguració estructural del vincle entre les grans tecnològiques i l’aparell de defensa.

En aquest nou escenari, el cas d’Anthropic resulta particularment revelador perquè l’empresa havia construït bona part de la seva identitat pública sobre l’eix de la seguretat i la mitigació de riscos. La seva Responsible Scaling Policy es va convertir en un dels marcs més citats per aquells que defensaven una aproximació més prudent al desenvolupament de models avançats. L’actualització d’aquesta política publicada el 24 de febrer de 2026 confirma que la companyia continua volent diferenciar-se en aquest terreny, però també mostra fins a quin punt aquestes polítiques continuen sent instruments de governança privada: les redacta l’empresa, les interpreta l’empresa i les modifica l’empresa. Aquest detall no és menor. Quan parlem de tecnologies amb potencial impacte militar, policial o geopolític, confiar en marcs interns sense supervisió democràtica robusta equival a acceptar que decisions d’enorme transcendència pública es juguin dins del perímetre de la gestió corporativa.

La pregunta central, per tant, ja no és si les companyies tecnològiques han de tenir principis. És clar que n’han de tenir. La qüestió decisiva és una altra: quin valor real tenen aquests principis quan el context canvia, quan apareix un contracte estratègic, quan la Casa Blanca o el Pentàgon pressionen, o quan un competidor està disposat a fer allò que una altra empresa rebutja. En aquesta tensió es mesura la solidesa de tota ètica corporativa. I el que hem anat observant en els darrers anys no convida precisament a l’optimisme. Moltes de les grans tecnològiques que en el seu moment van marcar distàncies amb determinats usos de la IA han anat ajustant el seu discurs a mesura que la seguretat nacional i la geopolítica es consolidaven com a vectors de negoci.

No és casual. La IA ha deixat de ser només un sector d’innovació per convertir-se en infraestructura de poder. Qui controla els models, el còmput, el núvol, les dades, les plataformes de desplegament i les integracions amb defensa no només guanya quota de mercat; guanya influència estratègica. En aquest marc, les declaracions ètiques poden funcionar també com a eines de posicionament, negociació i reputació. Aquí apareix el concepte d’ethics washing que López de Mántaras introdueix amb encert. La sospita no consisteix a afirmar que les empreses menteixen sempre, sinó a advertir que el llenguatge de l’ètica pot convertir-se en una coartada flexible: prou exigent per projectar responsabilitat davant reguladors, usuaris i inversors, i prou elàstica per no tancar la porta a contractes rendibles o aliances estratègiques.

Aquest matís importa molt. Una empresa pot prohibir de manera molt visible els sistemes d’armes totalment autònoms o la vigilància massiva interna i, alhora, participar en altres programes militars, d’intel·ligència o d’anàlisi operativa que plantegen dilemes igualment seriosos. Pot exhibir prudència en la retòrica i pragmatisme en l’execució. Pot, fins i tot, resistir-se a una exigència concreta de l’Estat i continuar plenament integrada en la lògica general de la militarització tecnològica. L’ètica, en aquest cas, no desapareix, però es converteix en un perímetre negociat. I quan els límits són negociables, deixen de ser una garantia sòlida per als ciutadans.

A més, hi ha una dimensió tècnica que impedeix tractar aquest debat com una mera lluita ideològica. Els models generatius no són eines infal·libles. La seva arquitectura probabilística permet respostes potents, útils i versàtils, però també errors, invencions i desviacions que no es poden eliminar completament. En un context comercial, aquesta fragilitat ja planteja problemes evidents. En un entorn militar, l’exigència és infinitament més gran. Una al·lucinació, una síntesi enganyosa, una interpretació errònia o una associació incorrecta no són fallades menors quan s’apliquen a intel·ligència, vigilància, classificació d’amenaces o avaluació d’escenaris de combat. El problema no és només la possibilitat d’error, sinó la temptació institucional d’utilitzar sistemes d’alt rendiment aparent en entorns on les conseqüències d’una equivocació poden ser irreversibles.

Per això l’episodi entre Anthropic i el Pentàgon interpel·la directament les democràcies. Si l’Estat exigeix accés sense restriccions, l’autonomia moral de l’empresa s’erosiona. Si l’empresa renuncia a límits per incentius econòmics o per por de perdre contractes, l’ètica corporativa es buida. I si tot aquest procés es produeix en absència de legislació clara i actualitzada, el resultat és un desplaçament silenciós de la sobirania democràtica cap a acords opacs entre administracions i proveïdors tecnològics. El preocupant no és només que la IA es militaritzi. El preocupant és que aquesta militarització es normalitzi abans que existeixi una discussió pública suficient sobre els seus llindars d’acceptabilitat, els seus mecanismes de control i les seves línies de responsabilitat.

Europa faria bé d’observar aquesta escena sense ingenuïtat. Mentre els Estats Units avancen cap a una convergència cada vegada més intensa entre indústria d’IA i seguretat nacional, la Unió Europea continua intentant construir un marc regulador basat en drets, transparència i supervisió. Però aquest esforç serà insuficient si no afronta de manera específica el desafiament militar i el problema de la dependència tecnològica. No n’hi ha prou amb regular aplicacions civils d’alt risc si els models, la infraestructura i bona part del múscul computacional continuen concentrats fora d’Europa i sotmesos a prioritats geoestratègiques alienes. La sobirania tecnològica, tan invocada i tan mal entesa de vegades, comença a ser inseparable de la capacitat de fixar límits propis.

En aquest sentit, el text de López de Mántaras té una virtut essencial: obliga a abandonar la comoditat del discurs neutralista. La intel·ligència artificial no és simplement una eina. És una tecnologia que reorganitza relacions de poder, accelera asimetries i pot reforçar capacitats estatals i corporatives d’una manera inèdita. Qui controli el seu desplegament en defensa, intel·ligència i seguretat interior no només tindrà avantatge tècnic, sinó capacitat per redefinir el perímetre del que és permès. Aquesta és la batalla real. I aquesta és també la raó per la qual el cas Anthropic-Pentàgon importa molt més del que la seva aparença contractual podria suggerir.

La qüestió decisiva ja no és si hi haurà intel·ligència artificial en l’àmbit militar. Aquesta fase ja està en marxa. La veritable pregunta és si la seva integració es produirà sota regles democràtiques, límits verificables i supervisió independent, o si s’imposarà una dinàmica en què l’Estat i les grans tecnològiques vagin fixant, de facto, les normes mitjançant contractes, excepcions, pressions i fets consumats. Aquest és el llindar que estem travessant. I un cop travessat, serà molt més difícil tornar enrere.

La guerra pels límits de la intel·ligència artificial ja ha començat. No es lliura només en laboratoris, despatxos ministerials o centres de comandament. També es lliura en el llenguatge amb què es justifica allò admissible, en l’opacitat amb què es firmen determinats acords i en la velocitat amb què una tecnologia encara insuficientment controlada s’incorpora a estructures de poder que rarament accepten frens per voluntat pròpia. El cas Anthropic és, en aquest sentit, un senyal d’època. El que està en joc no és només el futur d’una empresa ni l’equilibri d’una negociació amb el Pentàgon. El que està en joc és qui mana quan la guerra entra a l’algoritme.