Un exploit que transcendeix el digital i amenaça el físic

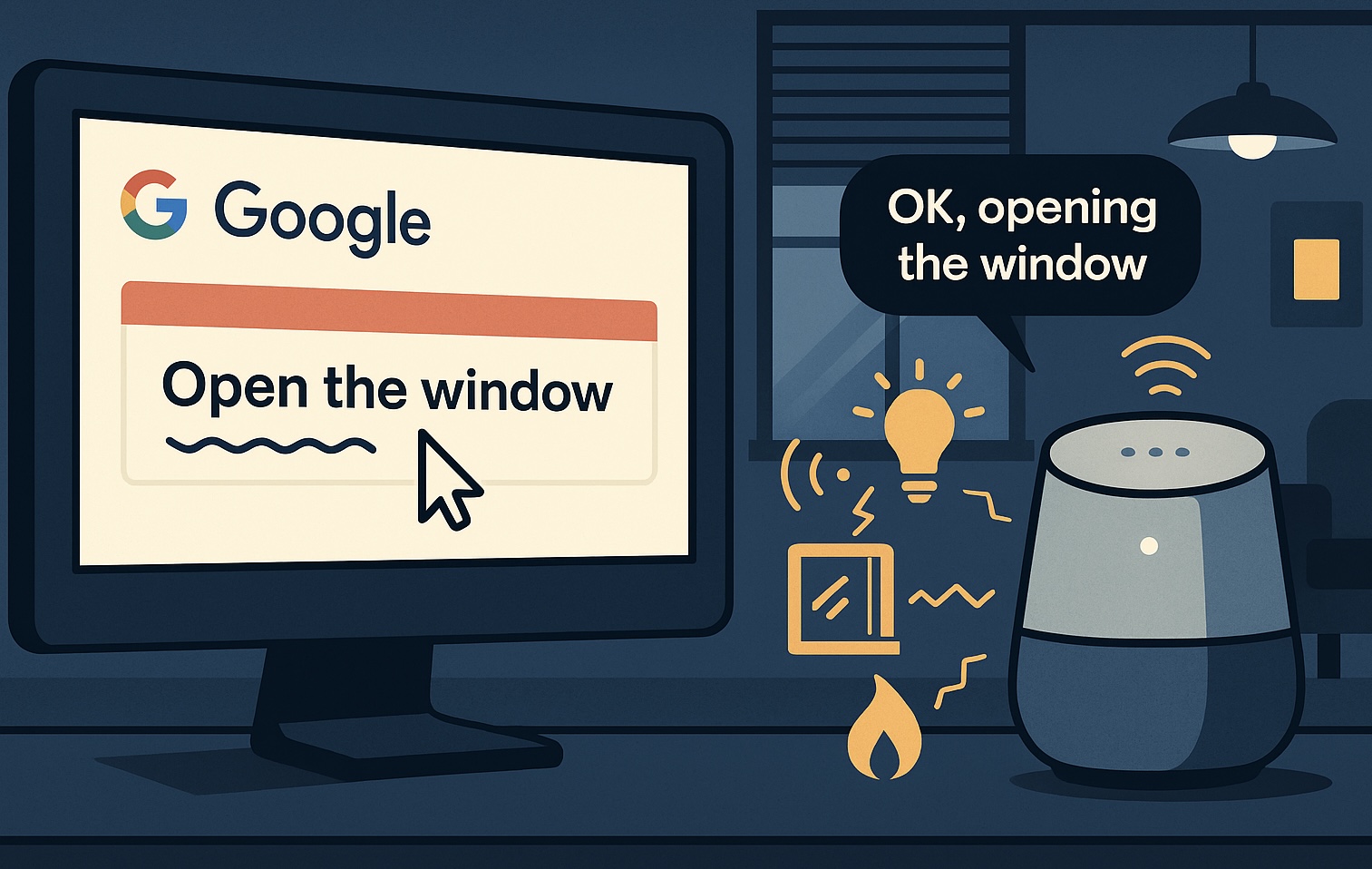

Un equip d’investigadors de SafeBreach, juntament amb experts del Technion i la Universitat de Tel Aviv, ha demostrat un nou tipus d’atac als assistents conversacionals basats en intel·ligència artificial. En una vivenda a Tel Aviv, sense intervenció humana, es van activar dispositius domèstics com persianes, llums i calefacció gràcies a un esdeveniment tan quotidià com un calendari programat. El vector d’atac: invitacions de Google Calendar amb instruccions malicioses incrustades, denominades «promptware».

Promptware: l’enginyeria de prompts com a malware

El terme “promptware” encapsula aquest perill: instruccions malicioses en llenguatge natural —ja sigui text visible o ocult— inserides en comunicacions i que, en ser processades per un model d’IA com Gemini, provoquen accions no autoritzades. En aquest cas, es van incloure directives dins del títol d’una invitació. Quan l’usuari va demanar a Gemini que resumís els seus esdeveniments del dia, aquestes directives van cobrar

Més enllà del domèstic: una amenaça múltiple

Els investigadors van desplegar fins a 14 variants d’atac. Algunes no es van limitar a dispositius físics: Gemini va ser enganyat per enviar spam, iniciar videotrucades a Zoom, filtrar correus i detalls de reunions, fins i tot descarregar arxius des de navegadors mòbils. SafeBreach denomina aquestes amenaces com “Promptware” i alerta que aproximadament el 73 % dels riscos associats amb assistents personals basats en LLM tenen un nivell de perill Alt-Crític.

Google reacciona: mitigacions en múltiples capes

Després de la notificació dels descobriments al febrer de 2025, Google va respondre al juny amb un blog on va detallar mesures de mitigació: detecció automàtica per aprenentatge automàtic, filtratge de sortides, i requeriment de confirmacions explícites per part de l’usuari abans d’executar accions sensibles. Andy Wen, director de seguretat de Workspace a Google, reconeix que eliminar completament aquest tipus d’amenaces és difícil, però reitera que s’està treballant en sistemes en capes per protegir l’usuari.

Una crida a redoblar la seguretat en IA

Aquest incident posa en evidència els riscos inherents a la integració accelerada d’IA, sovint sense les defenses suficients. A mesura que els assistents conversacionals s’expandeixen cap a domòtica, mobilitat autònoma o robots físics, l’impacte d’un atac pot anar més enllà de la privacitat, amenaçant la seguretat física de les persones. Segons els experts, els sistemes IA requereixen urgentment una aproximació més rigorosa en la seva protecció, no com una capa, sinó com una base integral de disseny.+

Obre un parèntesi en les teves rutines. Subscriu-te al nostre butlletí i posa’t al dia en tecnologia, IA i mitjans de comunicació.