QuitGPT: la campanya que demana cancel·lar ChatGPT pels acords amb Defensa i el gir polític d’OpenAI. Altman va assegurar que OpenAI comparteix les “línies vermelles” d’Anthropic —no vigilància massiva ni armes autònomes—, però alhora va reconèixer que les converses amb Defensa venien de “molts mesos” enrere.

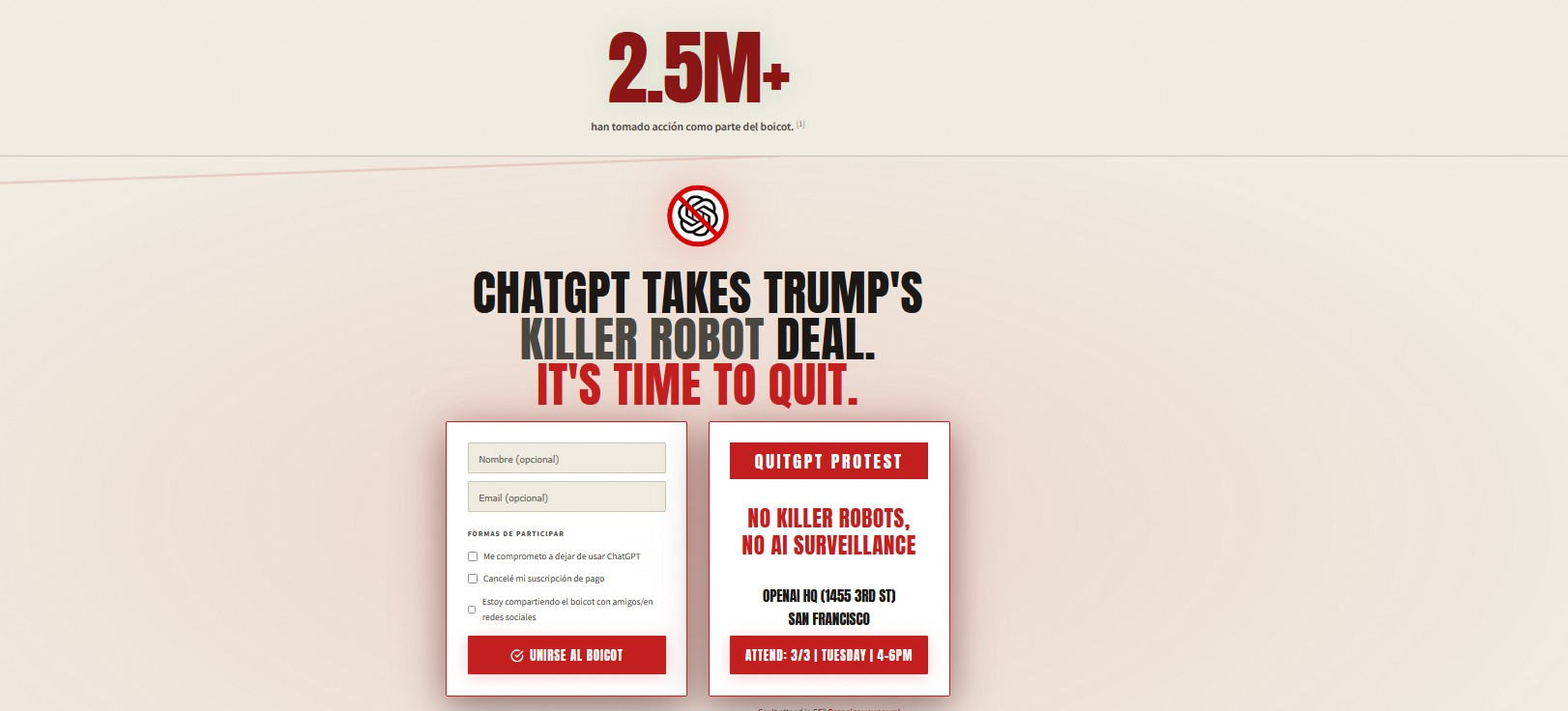

Des de fa unes setmanes circula una consigna directa i difícil d’ignorar: “QuitGPT” —una campanya que fa una crida a boicotejar ChatGPT i, en particular, a cancel·lar subscripcions per pressionar OpenAI. La seva web, https://quitgpt.org/, planteja el boicot com una eina de “cost baix” i “alt impacte” contra una empresa que, segons la campanya, s’ha alineat amb decisions governamentals controvertides i amb contractes de seguretat nacional que obren la porta a usos inacceptables.

El detonant immediat és l’acord d’OpenAI amb el Departament de Defensa / “Department of War” per desplegar models en xarxes classificades i la seva posterior ampliació o clarificació pública després del rebuig d’Anthropic a les condicions exigides pel Pentàgon. En paral·lel, el debat s’ha carregat d’electricitat política: articles d’opinió, cobertura internacional i un creixement visible del “boicot” com a fenomen social.

El que és rellevant per entendre per què aquesta campanya arrela no és només el contracte en si, sinó la seqüència: mentre el sector discutia en públic les “línies vermelles” que Anthropic defensava (no vigilància domèstica massiva i no armes letals autònomes), Sam Altman deia compartir aquests límits… i, gairebé al mateix temps, OpenAI tancava un acord propi amb Defensa. Aquesta simultaneïtat alimenta l’acusació que avui repeteixen activistes: “suport de cara a la galeria, negociació per darrere”.

Què és QuitGPT i què demana exactament

En la seva formulació, QuitGPT sosté que ChatGPT és l’objectiu més eficaç perquè és el producte de consum més massiu d’OpenAI i perquè el cost reputacional i d’ingressos d’una cancel·lació coordinada seria immediat. La campanya no es limita a “deixar d’usar”: insisteix a cancel·lar plans de pagament i a migrar a alternatives.

QuitGPT vincula el boicot a tres grans retrets:

- Relació amb agències i contractes de seguretat nacional (Pentàgon i, en el relat de la campanya, ICE).

- Donacions polítiques d’alts directius vinculades a l’òrbita Trump / MAGA Inc.

- Captura regulatòria / lobby, amb acusacions sobre despesa per frenar regulacions estatals (una afirmació present al web de la campanya, però que convé tractar com a al·legació mentre no hi hagi verificació independent cas per cas).

En aquest punt hi ha una diferència crucial entre fets verificats per mitjans i afirmacions de campanya. Per exemple, la donació de Greg Brockman i la seva esposa a MAGA Inc. per 25 milions de dòlars el 2025 ha estat reportada per diversos mitjans (i el mateix Brockman l’ha defensat públicament).

En canvi, altres peces de l’argumentari (com el detall tècnic exacte de “quina eina usa quina agència i sota quin contracte”) apareixen repetides en articles i agregadors, però exigeixen traçabilitat documental per no convertir propaganda en periodisme.

El cor del conflicte: “línies vermelles”, vigilància i guerra

La crisi esclata quan Anthropic es planta davant el Pentàgon per restriccions d’ús: la disputa, segons Reuters i cronologies especialitzades, venia de mesos i incloïa pressió per flexibilitzar límits sobre vigilància i armes autònomes.

En aquest context, treballadors d’OpenAI i Google van signar una carta oberta demanant mantenir aquestes línies vermelles i “no dividir-se” davant demandes governamentals.

Altman, en paral·lel, va comunicar internament que OpenAI compartia aquests límits. Axios ho va resumir així: no IA per a vigilància massiva i no IA per a armes letals autònomes.

I OpenAI va publicar després un text institucional sobre el seu acord amb el “Department of War” explicitant prohibicions: no vigilància domèstica massiva, no direcció de sistemes d’armes autònomes, i altres restriccions.

Fins aquí, la versió oficial intenta situar OpenAI en el camp “responsable”: cooperar amb Defensa, sí, però amb clàusules. El problema —i aquí és on QuitGPT troba combustible— és el timing i l’abast real.

“Altman ja negociava abans”: el que sí es pot afirmar amb fonts

La teva afirmació central (“Altman ja negociava amb el Pentàgon abans de donar suport públic a Dario Amodei”) té un component verificable i un altre d’interpretatiu:

- Verificable: Altman ha dit en declaracions recollides per mitjans que OpenAI feia “molts mesos” que parlava amb el Departament de Defensa/“Department of War” per feina no classificada, i que la part classificada “es va accelerar” aquella setmana.

- Interpretatiu: que això equivalgui a “donar suport públic a Amodei” com a maniobra mentre es negociava “quedar-se amb els contractes” depèn de com es llegeixin els seus missatges i de si hi va haver una coordinació oportunista. Aquí, el que és honest periodísticament és descriure la seqüència: solidaritat pública amb les línies vermelles + negociació prèvia reconeguda + tancament ràpid de l’acord.

És a dir: sí que hi ha base per sostenir que les converses no van començar “després” del gest públic, sinó abans. El que no es pot afirmar sense proves addicionals és la intenció concreta de “quedar-se amb els contractes” com a pla premeditat; això ja entra en terreny de motivacions i exigeix evidència directa.

Per què el boicot funciona com a símbol: diners, reputació i “llicència social”

Els boicots tecnològics rarament tomben una empresa per si sols, però de vegades aconsegueixen una cosa més immediata: canviar el cost reputacional d’una decisió i obligar una companyia a reaccionar ràpid.

Aquí ja s’ha vist un efecte: OpenAI ha fet control de danys, anunciant esmenes o clarificacions de l’acord, i Altman ha admès que la gestió comunicativa va ser “precipitada” i que el resultat “semblava oportunista”.

A més, Reuters informa que OpenAI explora ara un possible acord amb l’OTAN (en xarxes no classificades), cosa que manté el debat en primer pla sobre fins on arriba la col·laboració amb defensa.

QuitGPT, per la seva banda, intenta convertir aquesta pressió en una decisió quotidiana: “si pagues ChatGPT, finances aquest rumb”. Aquest marc moral es reforça amb la discussió sobre donacions polítiques i la relació amb agències.