La majoria d’eines que utilitzen intel·ligència artificial per editar imatges operen sobre un llenç pla, una matriu de píxels sense jerarquies internes. Apliquen filtres, eliminen objectes o canvien colors, però ho fan com si la imatge fos un bloc indivisible. El model Qwen‑Image‑Layered, presentat per l’equip de Qwen, proposa convertir qualsevol imatge en una estructura de capes RGBA, similars a les que utilitzen els programes professionals de disseny gràfic.

Separar per poder modificar

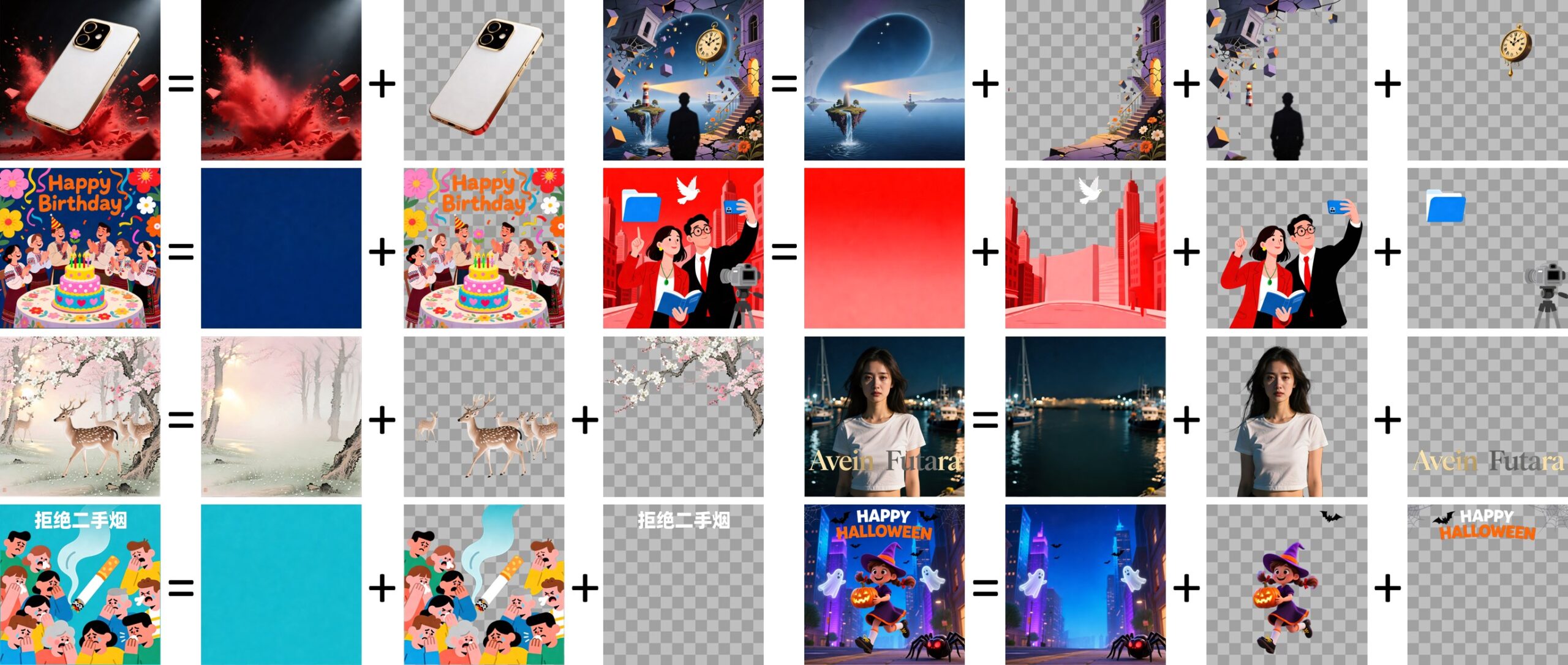

El model parteix d’una imatge estàtica i la descompon en múltiples capes, cadascuna amb un canal de transparència. Cada capa conté un element visual, el fons, un objecte, un text, una ombra. Aquesta separació permet modificar una part de la imatge sense afectar la resta. El resultat és una estructura editable en la qual es poden recolorar objectes, moure elements, canviar un personatge o reemplaçar un text sense alterar el seu context.

Això no és nou en edició professional, però sí que ho és en generació automàtica. Fins ara, els models d’IA treballaven amb representacions planes i aplicaven canvis en l’àmbit global. La proposta de Qwen és traslladar la lògica de les capes al camp de la generació i edició assistida per IA.

Arquitectura i disponibilitat

Tècnicament, Qwen‑Image‑Layered combina un autoencoder RGBA amb un model de difusió multimodal. Durant l’entrenament, el sistema aprèn a identificar components independents dins d’una imatge i assignar-los a capes diferents. Pot generar des de tres fins a una desena de capes, en funció de la complexitat de l’escena. Cadascuna s’exporta com una imatge RGBA amb el seu propi canal alfa.

El model està disponible a la plataforma Hugging Face i es distribueix sota llicència Apache 2.0. Això permet el seu ús i modificació per a fins de recerca o desenvolupament. També existeixen nodes experimentals en interfícies com ComfyUI, on es pot provar la generació i edició de capes de forma visual.

Aplicacions i limitacions

L’enfocament per capes permet operacions com substituir elements, editar text incrustat o recol·locar components sense necessitat de refer la imatge completa. És especialment útil en fluxos de treball on es requereixen múltiples versions d’una mateixa escena, comerç electrònic, disseny de productes o generació de materials promocionals.

No obstant això, el model encara té limitacions. La qualitat de la descomposició depèn del contingut de la imatge. En escenes complexes, pot generar capes amb elements barrejats o redundants. A més, no existeix per ara una integració directa amb eines d’edició comercials ni una API estable per a producció.

Un pas cap a edicions més estructurades

Qwen‑Image‑Layered introdueix una forma de representar les imatges que facilita l’edició selectiva i estructurada. Aporta una capa intermèdia entre la generació automàtica i l’edició professional, i pot servir com a base per a eines que requereixin precisió sense dependre d’intervenció manual. El seu impacte dependrà de com evolucioni la seva adopció i integració en entorns de treball reals.

Obre un parèntesi en les teves rutines. Subscriu-te al nostre butlletí i posa’t al dia en tecnologia, IA i mitjans de comunicació.